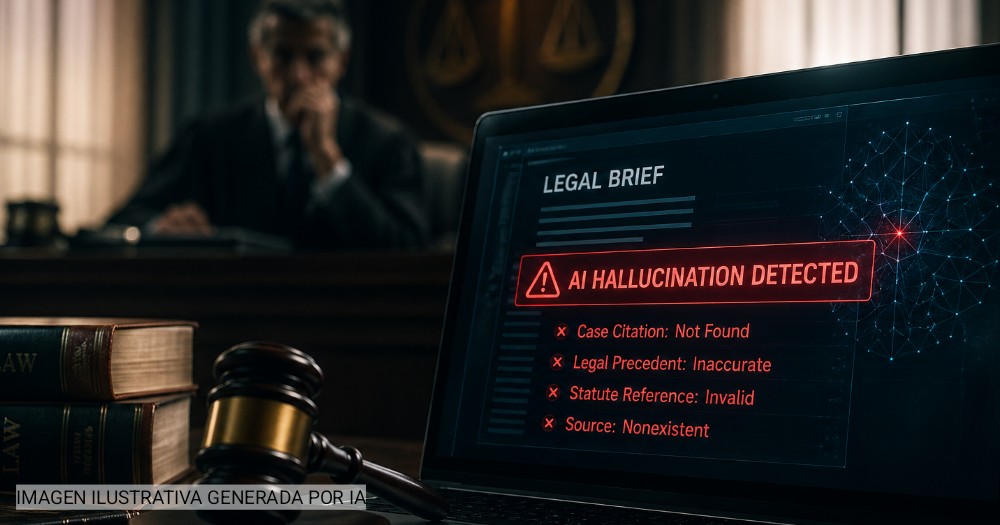

New York, Estados Unidos/ Un nuevo caso ha encendido las alarmas sobre el uso de inteligencia artificial en el ámbito jurídico, luego de que un documento presentado ante un tribunal incluyera múltiples errores generados por sistemas de IA, conocidos como “alucinaciones”.

El incidente ocurrió cuando un equipo legal presentó un escrito que contenía más de 40 errores, incluyendo referencias incorrectas o inexistentes. La situación obligó a los responsables a emitir una disculpa formal y corregir el documento ante la corte.

¿Qué ocurrió exactamente?

El documento judicial, elaborado con apoyo de herramientas de inteligencia artificial, incluyó citas legales aparentemente válidas pero que, en realidad, no existían. Este tipo de fallos se conoce como “alucinaciones de la IA”, un fenómeno en el que los modelos generan información falsa con apariencia convincente.

El problema no fue detectado inicialmente por los abogados, sino por la parte contraria, lo que expuso deficiencias en la verificación humana del contenido generado.El problema de fondo: confiar demasiado en la IA

Expertos advierten que este caso no es aislado. En los últimos años, se han documentado varios episodios en los que abogados presentan documentos con citas ficticias generadas por IA.

Las llamadas “alucinaciones” ocurren porque estos sistemas no “entienden” la información como un humano, sino que predicen texto basado en patrones, lo que puede llevar a errores cuando no hay suficiente contexto o verificación.

Impacto global y debate legal

El caso también refleja una brecha creciente entre el rápido avance tecnológico y su adopción responsable en sectores críticos como el sistema judicial. Mientras empresas tecnológicas promueven el uso de IA para aumentar la eficiencia, expertos legales insisten en que la supervisión humana sigue siendo indispensable.

Algunos tribunales ya han comenzado a imponer restricciones, exigiendo que cualquier contenido generado por IA sea revisado y validado por profesionales antes de ser presentado oficialmente.

Conclusión

El incidente refuerza una idea clave: la inteligencia artificial puede ser una herramienta poderosa, pero no infalible. En contextos donde la precisión es crítica —como el legal—, depender exclusivamente de estos sistemas sin verificación puede tener consecuencias graves.

La discusión ahora no es si la IA debe usarse en el derecho, sino cómo hacerlo sin comprometer la veracidad y la responsabilidad profesional.